给你一个整数数组 nums ,其中可能包含重复元素,请你返回该数组所有可能的子集(幂集)。

解集 不能 包含重复的子集。返回的解集中,子集可以按 任意顺序 排列。

示例 1:

输入:nums = [1,2,2]

输出:[[],[1],[1,2],[1,2,2],[2],[2,2]]示例 2:

输入:nums = [0]

输出:[[],[0]]代码:

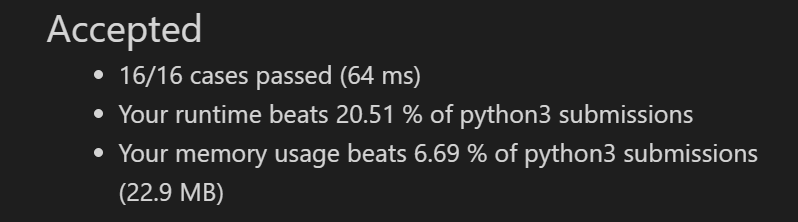

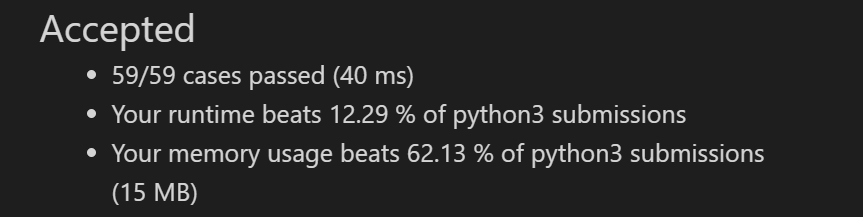

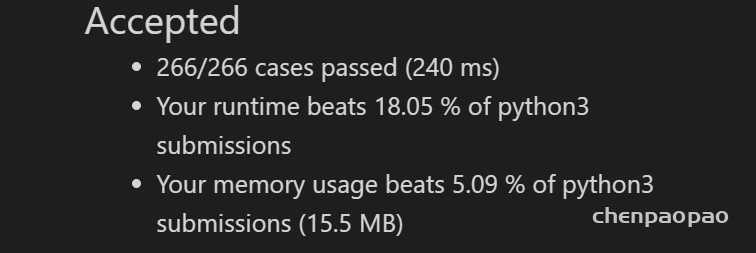

# @lc app=leetcode.cn id=90 lang=python3

#

# [90] 子集 II

#

# @lc code=start

class Solution:

def subsetsWithDup(self, nums: List[int]) -> List[List[int]]:

def combine(n: int, k: int):

rev=list()

res=list()

import copy

def f(n,k):

if k==0:

re=copy.deepcopy(rev)

res.append(re)

return

else:

for i in range(n,k-1,-1):

rev.append(nums[i-1])

f(i-1,k-1)

rev.pop()

f(n,k)

return res

re=list()

nums.sort()

for i in range(len(nums)+1):

res=combine(len(nums),i)

for item in res:

if not item in re:

re.append(item)

return re

# @lc code=end