神经网络结构搜索 (Neural Architecture Search) 的基础知识,包括超参数 (Hyper-parameters)、搜索空间 (Search Space)、随机搜索 (Random Search) 等概念。

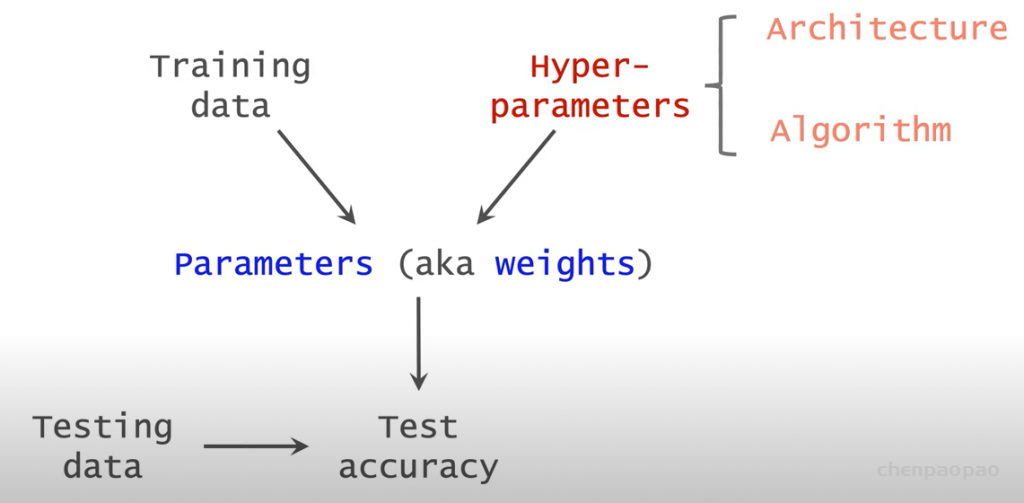

神经网络中有很多参数:

• Parameters :比如权重

• Hyper-parameter:搭建神经网络需要自己手动设置的一些参数(优化算法、epoch、学习率,网络结构等等)

如何自动调整超参数是一个很重要的方向。

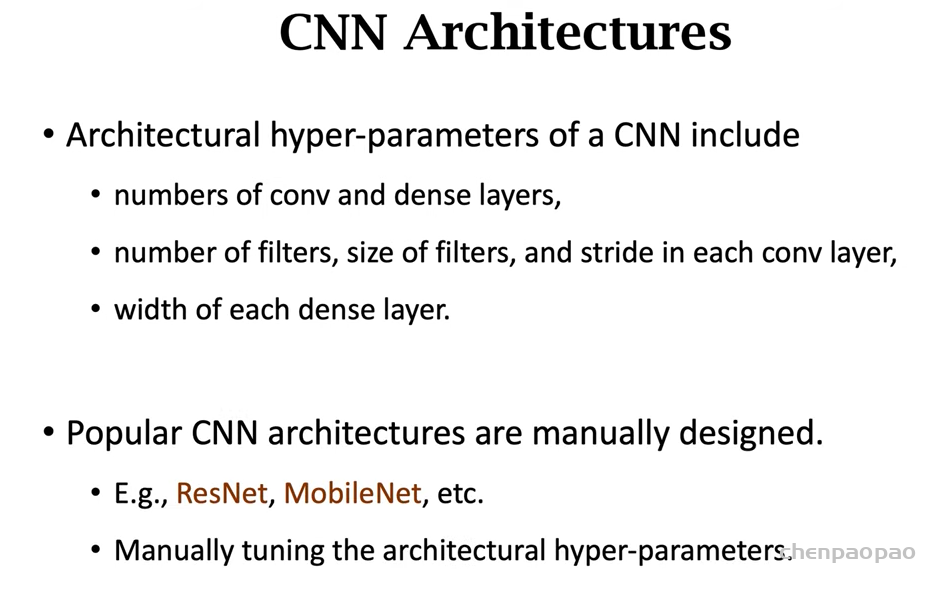

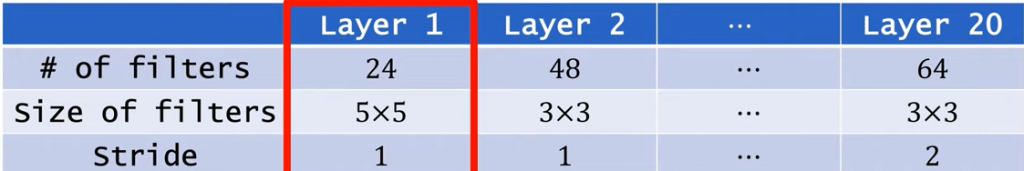

如何调整网络结构超参数:

什么是NAS?找到最优的网络结构使得结果最好。(也有一些附加条件:比如计算量最小、网络模型最小、运行速度等等)

我们不可能遍历所有的网络 超参数取值范围,因此需要一个搜索空间search space:搜索空间指的是所有可能的 网络结构。

NAS的输出:输出一个网络结构.

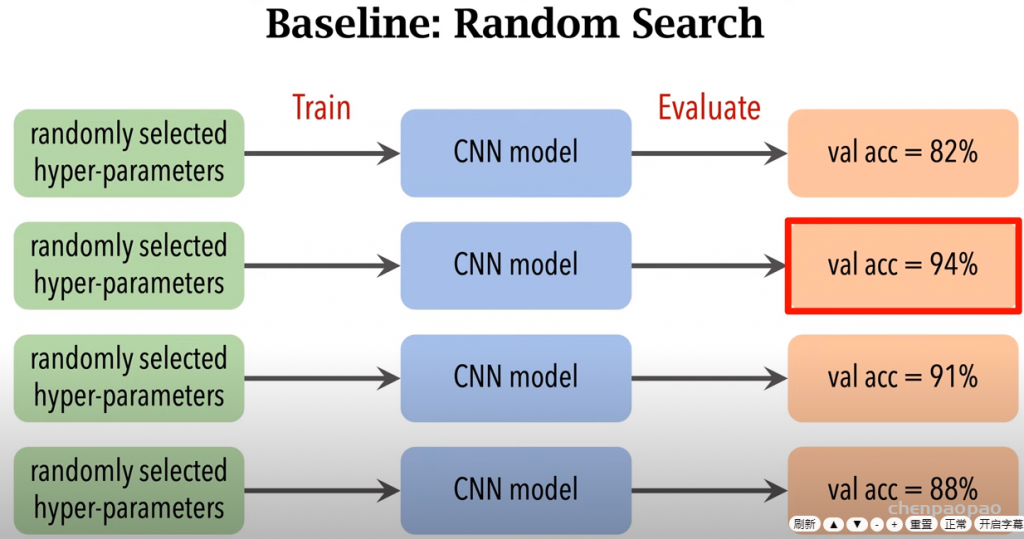

如何选取超参数?

1、随机搜索

从搜索空间随机选择一组超参数,然后使用这组超参数去训练一个CNN模型,一直到模型收敛,最后用测试集做预测。

重复上述过程:。。。。。

缺点:1、每次搜索的代价昂贵 2、搜索空间太大了