Qwen3.5-Omni 是 Qwen 最新一代全模态大模型,支持文本、图片、音频、音视频理解。结构上,Qwen3.5-Omni 的 Thinker 与 Talker 均采用 Hybrid-Attention MoE 架构。Qwen3.5-Omni 系列包含 Plus、Flash、Light 三种尺寸的 Instruct 版本,支持 256k 长上下文,模型支持超过 10 小时的音频输入及超过 400 秒的 720P(1 FPS)音视频输入。模型在海量文本、视觉以及超过 1 亿小时的音视频数据上进行原生多模态预训练,该模型展现出卓越的全模态感知与生成能力。相比 Qwen3-Omni,Qwen3.5-Omni 多语言能力大大增强,能够支持 113 种语种和方言的语音识别和 36 种语种和方言的语音生成。

Blog:https://qwen.ai/blog?id=qwen3.5-omni

模型架构

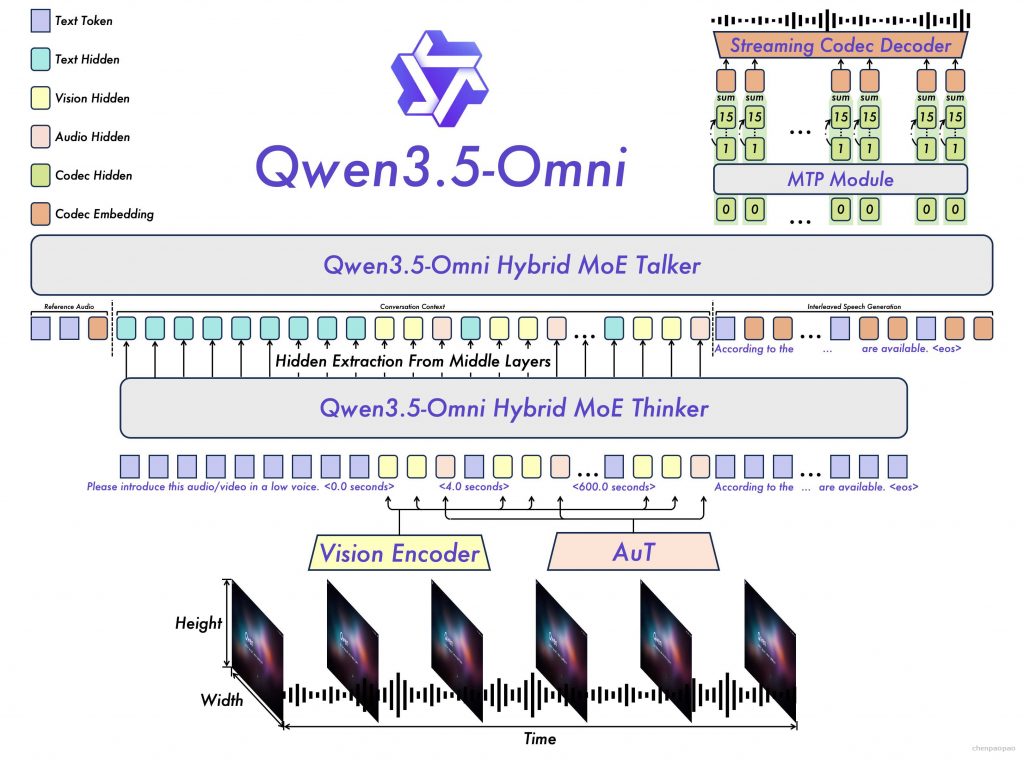

Qwen3.5-Omni 延续采用 Thinker-Talker 架构,Thinker 通过 Vision Encoder 和 AuT 接受视觉和音频信号输入,音视频信号通过 interleave 交织并搭配 TMRoPE 编码位置信息。Thinker 负责处理全模态信号并输出文本,Talker 负责接收来自 Thinker 的多模态输入以及文本输出,进行 contextual 语音生成,语音表征通过 Qwen3-Omni 提出的 RVQ 编码来替代繁重的 DiT 运算。由于 chunk-wise 的流式输入设计和流式 Talker 设计,整个模型可以进行 realtime interaction。不同于上一代 Qwen3-Omni 的双轨 Talker 输入,Talker 在输入的组织方式上采用了 ARIA(自适应速率交错对齐,Adaptive Rate Interleave Alignment)来动态对齐文本与语音单元,然后进行交错排布,以避免由于文本与语音 Token 编码效率差异导致的语音不稳定性,如漏读、误读或数字发音模糊等问题。

Qwen3.5-Omni vs Qwen3-Omni

| Qwen3-Omni | Qwen3.5-Omni | |

| 主干框架 | MoE | Hybrid-MoE |

| 支持序列 | 32k | 256k 音频:10个小时 音视频 (FPS=1):400秒 |

| Caption能力 | 音频 | 音视频 |

| 智能语义打断 | 无 | 支持 |

| WebSearch/Tool | 无 | 原生API支持 |

| 语音控制 | 无 | 支持 |

| 音色克隆 | 无 | 支持 |

| Talker | 双轨自回归 | Interleave |

| Text-Audio Tokenizer Rate | Fixed (1:1) | ARIA (Adaptive Rate Interleaved Alignment) |

| 语音识别 | 11种多语言:中文、英语、德语、法语、意大利语、泰语、韩语、日语、俄语、西班牙语、葡萄牙语 8种方言:四川话、上海话、粤语、闽南语、陕西话、南京话、天津话、北京话 | 74种多语言:南非语、阿拉伯语、阿斯图里亚斯语、阿塞拜疆语、巴斯克语、白俄罗斯语、孟加拉语、波斯尼亚语、保加利亚语、粤语、加泰罗尼亚语、宿务语、中文、克罗地亚语、捷克语、丹麦语、荷兰语、英语、世界语、爱沙尼亚语、菲律宾语、芬兰语、法语、加利西亚语、格鲁吉亚语、德语、希腊语、希伯来语、印地语、匈牙利语、冰岛语、印尼语、国际语、意大利语、日语、爪哇语、卡纳达语、哈萨克语、韩语、柯尔克孜语、林加拉语、拉脱维亚语、立陶宛语、马其顿语、马来语、马拉雅拉姆语、马耳他语、毛利语、马拉地语、蒙古语、挪威语(博克马尔)、新挪威语、奥里亚语、波斯语、波兰语、葡萄牙语、旁遮普语、罗马尼亚语、俄语、塞尔维亚语、斯洛伐克语、斯洛文尼亚语、西班牙语、斯瓦希里语、瑞典语、塔吉克语、泰米尔语、泰卢固语、泰语、土耳其语、乌克兰语、乌尔都语、维吾尔语、越南语 39种方言:东北话、贵州话、广东粤语、河南话、香港粤语、上海话、陕西话、天津话、台湾话、云南话、安徽话、福建话、甘肃话、广东普通话、湖北话、湖南话、江西话、山东话、山西话、四川话、广西话、海南话、重庆话、长沙话、杭州话、合肥话、银川话、郑州话、沈阳话、温州话、武汉话、昆明话、太原话、南昌话、济南话、兰州话、南京话、客家话、闽南语 |

| 语音合成 | 11种多语言:中文、英语、德语、法语、意大利语、泰语、韩语、日语、俄语、西班牙语、葡萄牙语 8种方言:四川话、上海话、粤语、闽南语、陕西话、南京话、天津话、北京话 | 29种多语言:中文、英语、德语、意大利语、葡萄牙语、西班牙语、日语、韩语、法语、俄语、泰语、印度尼西亚语、阿拉伯语、越南语、土耳其语、芬兰语、波兰语、印地语、荷兰语、捷克语、乌尔都语、他加禄语、瑞典语、丹麦语、希伯来语、冰岛语、马来语、挪威语、波斯语 7种方言:四川话、北京话、天津话、南京话、陕西话、粤语、闽南语 |

离线(Offline)

Qwen3.5-Omni-Plus 在音频/音视频的理解、推理和交互任务上共取得了 215 项子任务/Benchmark 的 SOTA 成绩,涵盖 3 个音视频 Benchmark、5 个音频 Benchmark、8 个 ASR Benchmark、156 个面向语种的 S2TT 任务和 43 个面向语种的 ASR 任务。其中,通用音频理解/推理/识别/翻译/对话全面超越 Gemini-3.1 Pro,音视频理解能力总体达到 Gemini-3.1 Pro 水平,同时视觉/文本能力达到同尺寸 Qwen3.5 模型效果。Qwen3.5-Omni-Plus 的一个强大的 feature 是音视频 caption 能力,可以生成可控的、详细的、结构化的音视频 caption,并生成剧本级细粒度描述,包括自动切片、时间戳打标和人物与音频关系的详细介绍。除此以外,通过原生多模态 Scaling,我们观察到了全模态模型涌现出了可以根据音视频指令直接进行 coding 的能力,我们称之为 Audio-Visual Vibe Coding

实时(Realtime)

除了强大的基座能力,更进一步地,我们着重加强了 Qwen3.5-Omni 的交互能力。第一,我们支持了语义打断,基于 Omni 开发了自动识别 turn-taking 意图的能力,避免附和和无意义背景音打断,该能力在 API 中已原生支持;第二,我们原生支持了 WebSearch 和复杂 Function Call 的调用能力,模型可以自主判断是否需要拉起 WebSearch 来回应用户的即时问题;第三,我们支持了端到端的语音控制和对话,让模型可以像人一样遵循指令,对声音的大小、语速、情绪等进行自由控制;第四,Qwen3.5-Omni 支持音色克隆,用户上传音色来定制 AI Assistant 音色,以上功能可以在 Realtime API 上进行体验。用户也可以自行更改 system prompt,来改变口语化、身份等信息,从而改变模型的行为;第五,针对流式语音交互中由于文本与语音 Token 编码效率差异导致的语音不稳定性,如漏读、误读或数字发音模糊等问题,我们提出了 ARIA(自适应速率交错对齐,Adaptive Rate Interleave Alignment)技术,动态对齐文本与语音单元,在保证实时性的前提下,显著提升了语音合成的自然度与鲁棒性。